Im Rahmen des RBBW-BarCamps “Weiterbildung neu denken” konnte ich einen Impuls zum Thema “ChatGPT & Co.als persönliche Assistenzsysteme in Arbeits- & Lernwelten” einbringen. Eine Impression zum BarCamp und meine Folien zum Impuls.

Die Veranstaltung

Das 8. digitale BarCamp “Weiterbildung neu denken” der Regionalbüros für berufliche Fortbildung Baden-Württemberg am 12.12. 2023 stand unter dem Motto “Umbruch – Zeitenwende – Zukunftsvisionen”. Ich war eingeladen, eine Impulsvortrag für die Veranstaltung einzubringen. Als Thema hatten wir vereinbart: “ChatGPT & Co.als persönliche Assistenzsystemein Arbeits- & Lernwelten”.

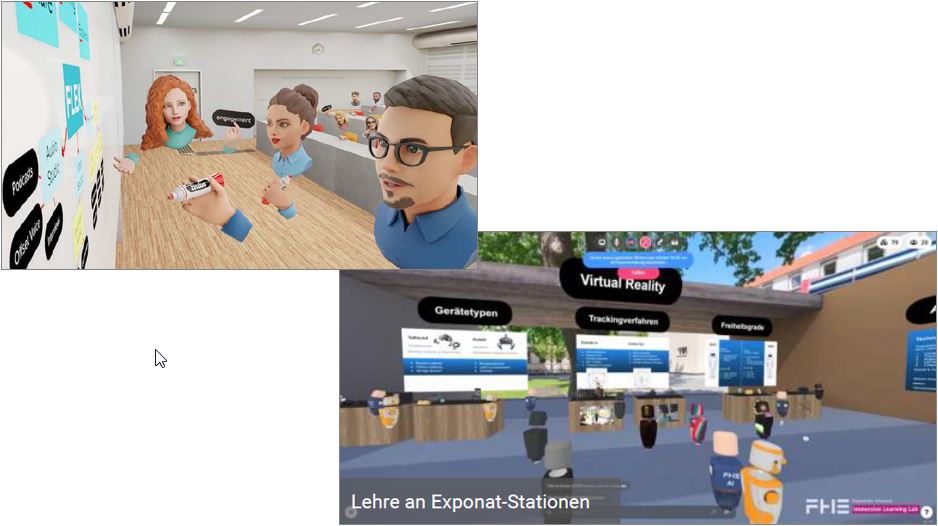

Die Veranstaltung, die auf der Plattform Gather.Town durchgeführt wurde, war mit ca. 150 Teilnehmenden und Teilgebenden gut besucht.

Mein Impuls

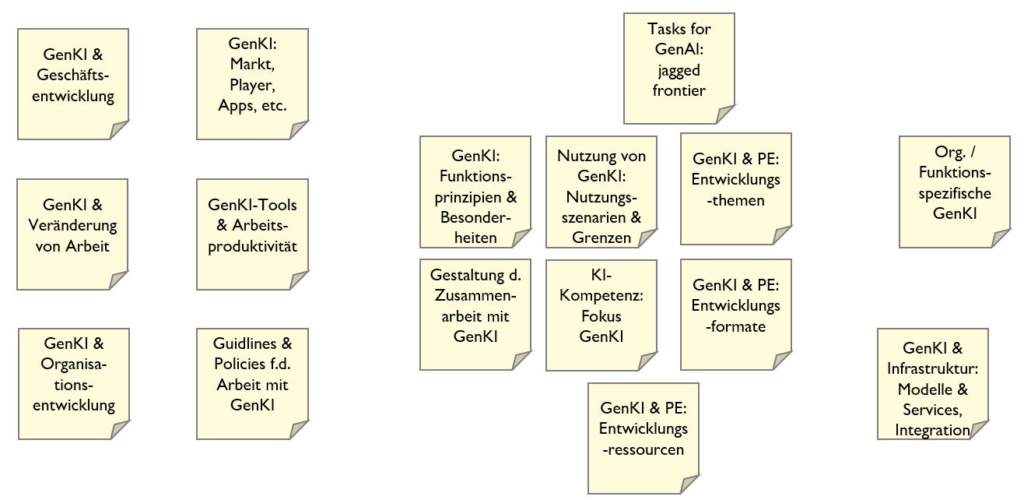

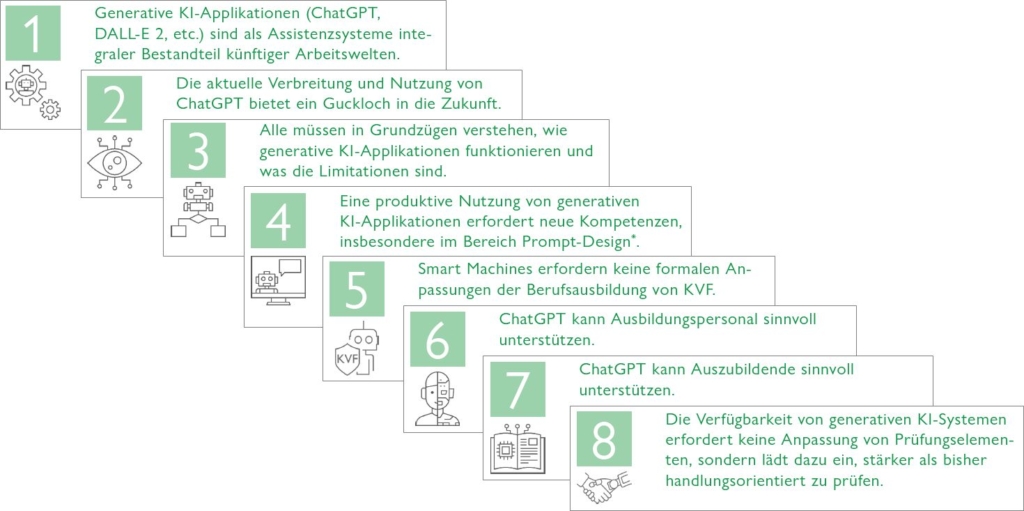

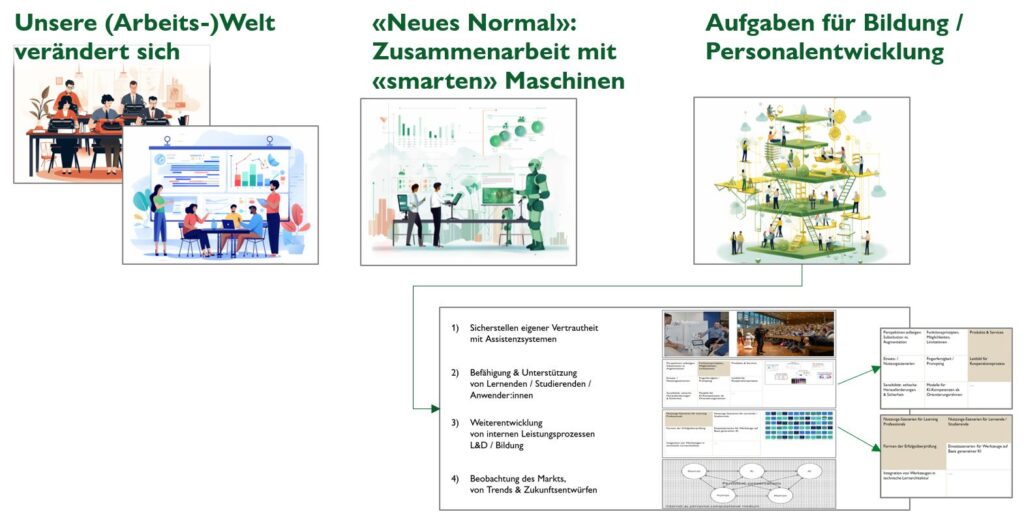

In meinem Impuls habe ich mich an der Struktur früherer Vorträge zum Thema orientiert:

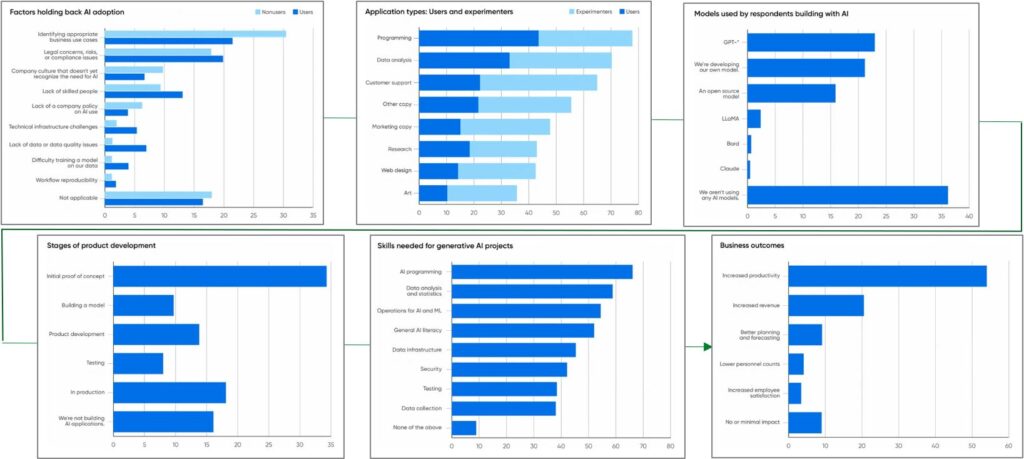

- Unsere Arbeitswelt verändert sich:

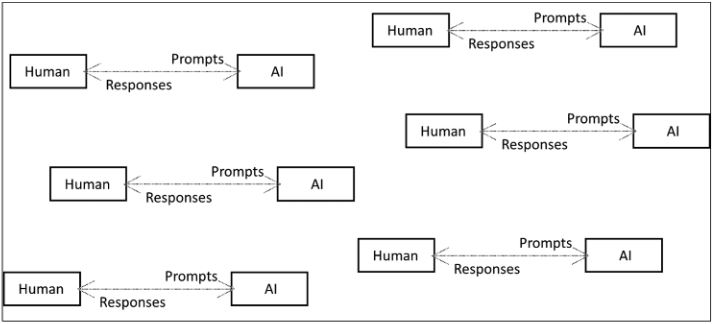

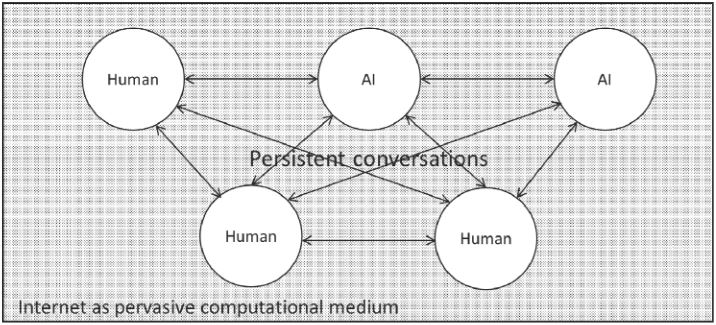

u.a. durch die Entwicklungen im Bereich generativer KI; - Das kollaborative Zusammenarbeiten mit “smarten” Maschinen wird zum neuen Normal:

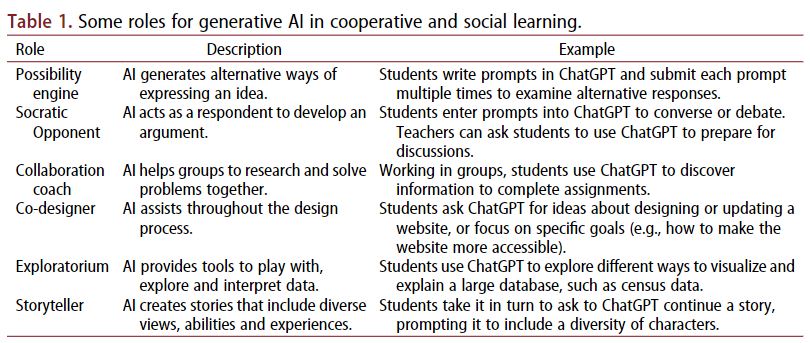

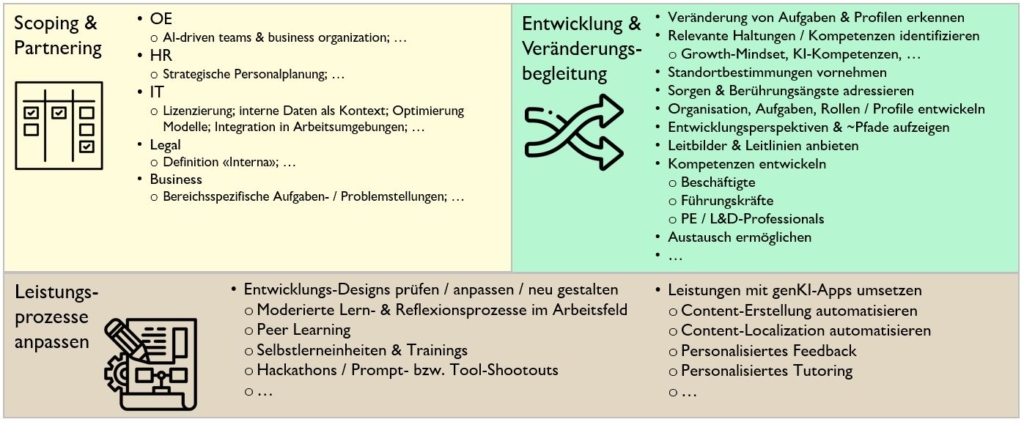

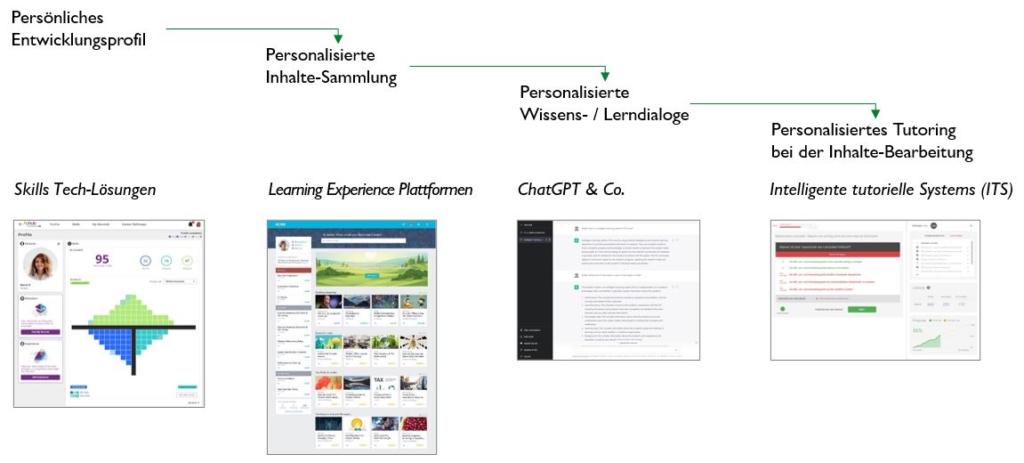

beispielsweise, wenn wir MS 365 Copilot nutzen; - Daraus ergeben sich neue Aufgaben und Herausforderungen im Bereich Bildung / Personalentwicklung:

- Wir müssen selbst mit den neuen Werkzeugen vertraut werden;

- Wir müssen andere befähigen / dabei unterstützen, mit diesen Werkzeugen produktiv arbeiten zu können;

- Wir müssen prüfen, ob und inwiefern es bei unseren eigenen Leistungsprozessen im Bereich Bildung / L&D / PE Anpassungen und Weiterentwicklungen braucht;

- Beobachtung des Markts für Applikationen sowie von Trends und Zukunftsentwürfen für Bildung / Personalentwicklung.

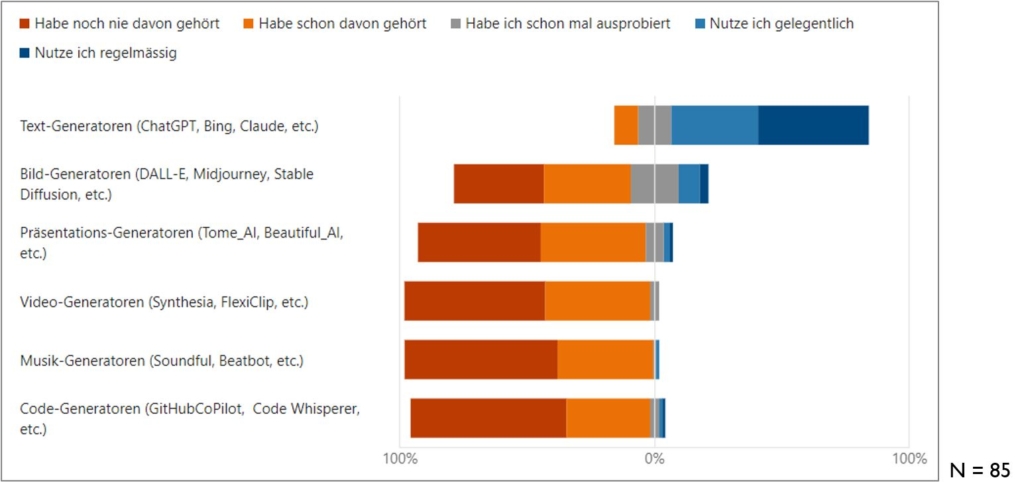

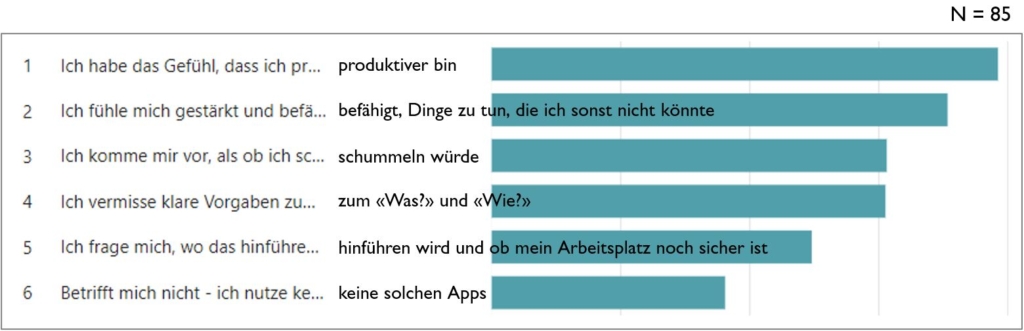

Hier die Folien zu meinem Beitrag für das BarCamp:

Vertiefung: Folgen für Learning Professionals in spezifischen Rollen / Profilen

In einer der Sessions des BarCamps haben wir dann noch einen Aspekt weiter diskutiert – nämlich die Frage, inwiefern die von mir aufgezeigten Entwicklungen im Bereich generative KI Auswirkungen auf verschiedene Rollenprofile von Learning Professionals / Bildungsverantwortlichen haben.

Dabei haben wir folgende Rollen bzw. Profile unterschieden:

- Center of Competence (-> Leitlinien & Grundkonzepte / Methoden / etc.)

- Anbieter (-> Gestaltung / Realisierung / Umsetzung)

- Makler / Vermittler (-> Content-Curation und Anbieter-Auswahl)

- Befähiger / Ermöglicher (-> Lernberatung / Lernbegleitung & Impulse zur Lernkultur)

- Service & Administration (-> u.a. Orchestrieren von technischen Lernarchitekturen)

Mit der Verfügbarkeit von Anwendungen auf Basis von generativer KI akzentuiert sich hier eine Entwicklung, die auch bislang schon zu beobachten war. Nämlich dass mehr und mehr KI-basierte Werkzeuge zur Unterstützung dieser Rollen und der damit verbundenen Aufgaben verfügbar sind. Die Gefahr, dass Learning Professionals dadurch überflüssig werden, haben wir nicht gesehen. Allenfalls wird die Rolle “Befähiger / Ermöglicher” noch wichtiger.